報導摘要

人工智慧(AI),特別是大型語言模型(LLM)的爆炸性成長,為企業帶來了前所未有的生產力。然而,這種創新速度遠超以往任何技術浪潮,隨之而來的「AI黑箱」特性、複雜的AI供應鏈以及LLM特有的安全漏洞,已使傳統資安工具難以有效應對。AI安全態勢管理(AI-SPM)正是在此背景下誕生的新興安全層,它專注於AI生態系統,持續監測、評估並修復組織整個AI覆蓋範圍內的安全和合規風險。AI-SPM借鑒了雲端安全態勢管理(CSPM)和資料安全態勢管理(DSPM)的經驗,提供對AI資產的端到端可見性,並針對OWASP LLM Top 10等關鍵威脅提供具體、可執行的防禦措施。事實證明,無論是單獨部署或作為更廣泛的融合平台(如SASE)的一部分,AI-SPM都已成為保障AI應用安全、可信賴與合規性的標準且不可或缺的工具。

一、引言:AI加速創新下的資安防線重構

AI的快速發展標誌著數位轉型的下一階段。從自動化流程到增強決策能力,LLM正在嵌入到企業營運的每個角落。然而,這也擴大了舊有安全工具無法管理的攻擊面。AI系統的獨特之處在於其高動態性、非確定性輸出以及對大量數據的高度依賴性,這些特徵催生了有別於傳統軟體漏洞的新型威脅,例如透過惡意輸入操縱模型行為、訓練數據受污染以及自主代理執行未經授權操作。

傳統資安工具主要專注於網路邊界、端點和應用程式程式碼的靜態分析。它們缺乏對模型生命週期中特定風險的理解,例如模型在訓練階段的資料投毒風險,以及在推理階段(運行時)的惡意提示注入。企業為了充分利用AI的競爭優勢,必須在風險管理上進行同步升級,從被動應對轉向主動的「安全態勢管理」,以確保AI技術能成為一項顯而易見的資產,而非潛在的隱形風險。AI-SPM正是為了填補這一資安鴻溝而設計的關鍵機制。

二、 AI-SPM 的核心定義、價值與產業共識

AI安全態勢管理(AI-SPM)是一個專門針對人工智慧生命週期(包括模型的開發、訓練、部署與運行)中安全問題而設計的全面性框架與技術。它不只是一個單一工具,而是一組旨在提供持續性可見性、風險評估與主動修復能力的機制。

AI 安全態勢管理(註) (AI security posture management , AI-SPM) 是一個相對較新的安全層,可協助組織識別並降低與使用 AI(尤其是大型語言模型)相關的風險。它能夠持續發現、評估並修復組織整個 AI 覆蓋範圍內的安全和合規風險。 開源非營利組織OWASP發布了一份由 LLM 應用程式帶來的威脅清單,其中包括與生成式 AI 相關的風險。這些威脅包括即時注入、資料外洩、代理濫用和錯誤配置。 AI 安全態勢管理提供了具體、實用的防禦措施,將這些複雜的風險轉化為可執行的保護措施。 人工智慧的快速發展速度遠超以往任何科技浪潮。它帶來了新的威脅,並擴大了舊工具無法管理的攻擊面。 AI-SPM 旨在保護這一新領域,使人工智慧成為一項顯而易見的資產,而非隱形風險。無論是作為SASE等融合平台的一部分,或是單獨部署,AI-SPM 都是實現安全、可擴展且合規的人工智慧應用的關鍵工具。

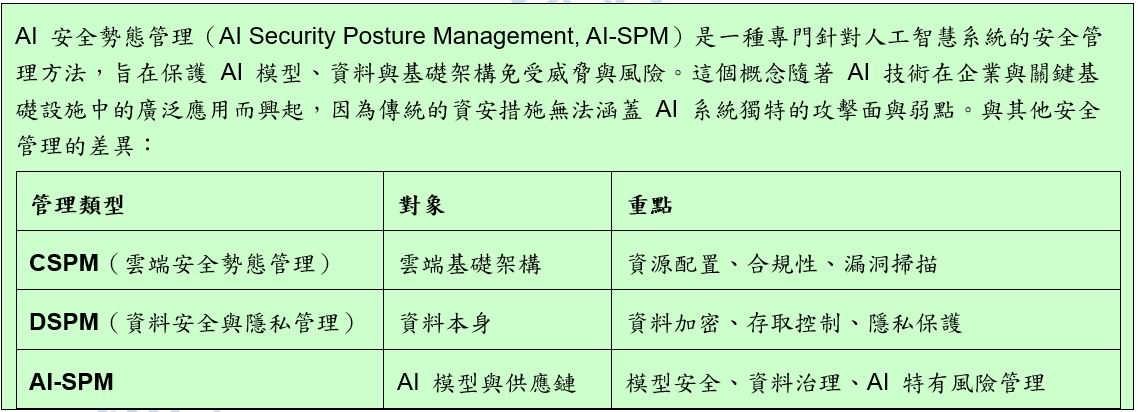

註:

2.1 借鑒現有安全管理模型

AI-SPM 的理念並非憑空出現,它汲取了現有資安管理框架的精髓並加以特化,以應對AI系統的複雜性:

雲端安全態勢管理(CSPM): 提供對雲端基礎設施中錯誤配置的持續監控和修復,AI-SPM 擴展此能力至AI相關的雲端資源(如訓練環境、API閘道)。

資料安全態勢管理(DSPM): 關注數據的發現、分類、流動和存取控制,AI-SPM 則特別關注用於訓練和推理的敏感數據,確保其不被惡意模型或未授權的用戶暴露。

雲端基礎設施權限管理(CIEM): 專注於管理雲端環境中的身份與權限,AI-SPM 將此應用於代理(Agent)和模型對敏感API或下游系統的存取權限控制,實施最小權限原則。

2.2 核心功能與治理目標

AI-SPM 的目標是通過將不透明的AI互動變得透明且可管理,允許企業自信地創新。其核心功能包括:

AI資產的發現與盤點: 識別並維護組織內所有AI模型、資料來源、資料管線、AI代理及相關雲端資源的清單。這對於對抗「影子AI」尤為重要。

風險評估與合規映射: 持續評估AI資產中的漏洞、錯誤配置(如不當加密、記錄、驗證或授權設定),並將這些風險映射到既定的框架(如OWASP LLM Top 10、NIST AI RMF、MITRE ATLAS)與法規(如GDPR、各種AI法案)。

運行時控制與流量檢查: 在AI互動的實時運行過程中,像安全堆棧(Security Stack)一樣運作,檢查和控制相關流量,以防止未經授權的存取、不安全的輸出和政策違規。

三、 AI-SPM 對應 OWASP LLM 十大風險的實戰防禦

LLM應用程式引入的威脅具有獨特性和嚴重性。AI-SPM 作為實用的防禦層,提供了具體的技術手段來對抗這些複雜的風險。

3.1 提示注入(Prompt Injection)與越獄(Jailbreaking)的遏制

威脅本質: 攻擊者或一般用戶透過精心設計的惡意輸入(如繞過系統指令或模擬系統級別命令),使模型執行非預期行為,例如繞過安全協議或生成有害輸出。這涉及濫用模型透過輸入提示學習和遵循指令的能力。 AI-SPM 實戰防禦:

輸入清理與驗證: 專門設計的過濾機制用於在提示到達LLM之前檢測並清洗惡意或高風險的輸入,例如潛在的系統指令或繞過嘗試。

邊界強制執行: AI-SPM 在模型運行時強制執行定義的安全邊界,阻止越獄成功後的輸出傳遞給使用者或外部平台,確保模型始終在預設的安全範圍內運行。

開發者工具監控: 監測程式碼助手和IDE插件的輸出,以檢測可能導致不安全程式碼或未經授權行為的提示和生成內容。

3.2 敏感資料揭露(Sensitive Data Disclosure)與治理

威脅本質: LLM可能因其訓練數據或運行時輸入而意外洩露個人身份資訊(PII)、財務數據或專有知識產權,違反隱私法規。 AI-SPM 實戰防禦:

數據脫敏與阻擋: 在輸入發送到公開或第三方模型之前,AI-SPM 會主動阻止或匿名化敏感資料。

輸出內容過濾: 運行時檢查模型的輸出響應,利用數據丟失防護(DLP)技術來識別並紅線處理(Redact)任何敏感或受監管的資訊,防止其被使用者或外部系統存取。

基於身份的存取控制: 根據使用者身份、他們的使用情境以及模型本身的敏感度來劃分不同的AI應用程式使用權限,執行精細化的存取規則。

3.3 資料與模型中毒(Data and Model Poisoning)的預警與修復

威脅本質: 透過在訓練數據中嵌入惡意樣本,攻擊者可以妥協模型的完整性、性能,並植入後門或偏見,導致模型在特定條件下產生錯誤或有害的決策或輸出。 AI-SPM 實戰防禦:

模型溯源與完整性檢查: AI-SPM 建立並維護模型及其版本歷史的中央庫存清單,確保只有來自受信任且經過驗證的資料源用於模型開發和微調,從而管理供應鏈風險。

運行時異常行為檢測: 系統持續監控模型在生產環境中的行為,主動識別異常的輸出,例如有毒內容、操縱的響應或非預期的偏見,並在發佈到生產環境前標記進行修復。

模擬紅隊演練: 支援並整合運行時安全測試,以檢測由惡意數據或不良訓練過程所導致的潛在漏洞。

3.4 過度代理權限(Excessive Agency)與供應鏈風險的雙重控制

威脅本質:

過度代理權限: AI代理(Agentic AI)及其插件擁有執行外部操作(如呼叫API、發送郵件)的能力。如果權限過度,可能導致未經授權的系統交互或權限提升。

供應鏈風險: 依賴第三方模型、函式庫或開源組件可能引入漏洞、中毒數據或合規性缺口。 AI-SPM 實戰防禦:

代理工作流程編目: AI-SPM 紀錄AI代理的決策路徑和行動,並對其可以執行的操作和可以存取的資源進行精細、運行時的控制。

最小權限原則強制: 嚴格鎖定敏感API的存取權限,確保代理在整個生命週期中始終在最小權限的原則下運行。

模型資產盤點與掃描: AI-SPM 內建掃描工具,用於檢查所有引入的模型及其相依性是否存在錯誤配置、已知的漏洞或合規性問題,確保模型在進入生產環境前符合既定的驗證標準。

3.5 系統提示洩露(System Prompt Leakage)的精準防護

威脅本質: 系統提示(System Prompt)包含了模型運行所需的高度敏感指令和邏輯。一旦洩露,攻擊者可藉此繞過控制、深入了解應用程式的內部運作方式,並利用模型行為。 AI-SPM 實戰防禦:

危險模式檢測: AI-SPM 持續分析使用者輸入,尋找試圖移除或修改內建指令的危險模式,在這些嘗試發展成安全問題前進行攔截。

非受控環境的禁用: 透過識別並阻止使用未經批准的AI工具和服務,AI-SPM 有效地預防了系統提示在不安全或配置不當的LLM環境中被洩露的風險。

結合提示注入防護: 系統提示洩露往往是提示注入攻擊的結果,AI-SPM 的提示注入和越獄防護機制同時也起到保護內核指令不被探測或更改的作用。

四、 新興威脅:影子AI與多雲環境的挑戰與AI-SPM的應對策略

除了LLM本身的技術風險外,AI技術的廣泛應用還帶來了組織層面的治理挑戰,其中「影子AI」(Shadow AI)和多雲環境下的碎片化管理是兩大關鍵。

4.1 影子AI:資產可見性缺失的風險

威脅本質: 員工未經IT或資安團隊授權,使用公共AI工具(如公開的LLM服務、未受管控的程式碼助手),這可能涉及將敏感或專有數據上傳,無意間規避了企業治理和合規規則。這種缺乏可見性的「影子AI」行為,是數據外洩和合規違規的隱形漏洞。 AI-SPM 實戰防禦:

跨平台識別與盤點: AI-SPM 的核心是識別在網路、端點、雲端平台和開發環境中所有正在使用中的AI工具(無論是否被批准)。

數據流動映射: 繪製數據在這些工具之間的流動路徑,從而瞭解數據暴露和洩露的風險。

實施防護欄: 一旦識別出風險,AI-SPM 可以實施角色基於存取的審批流程、透過安全閘道路由AI活動,或主動阻擋高風險的上傳行為,隔離未知的或不合規的AI代理。

4.2 多雲與混合環境下的AI風險評估

現代企業的AI資產往往分散在多個雲端服務供應商(AWS、Azure、GCP)和內部部署環境中。這種碎片化使得風險管理變得複雜,因為缺乏統一的風險視角。

五、 結論與未來展望:AI-SPM 標準化之路

人工智慧的顛覆性力量要求資安策略進行根本性的轉變。傳統資安架構的被動、以邊界為中心的特性,無法有效地保護動態、自主且數據驅動的AI系統。

AI-SPM 正是為了解決這一代差而設計的,它透過持續監控、風險映射和主動防禦,提供了企業在AI時代所需的「安全底座」。它將模型訓練、數據治理、運行時保護和供應鏈管理融為一體,確保AI的採用是安全、可擴展且合規的。

AI-SPM 的未來趨勢將包括:

與現有資安生態系統的深度整合: AI-SPM 將越來越多地整合到既有的安全資訊和事件管理(SIEM)、可觀察性工具(Observability Tools)中,使資安團隊能夠更容易地對AI相關事件進行分類、鑑識和響應。

納入法規框架: 隨著全球(如歐盟AI法案)和地區(如台灣的相關法規)AI治理法規的成熟,AI-SPM 的功能將會被標準化,成為企業證明AI合規性的必要工具。

支持更複雜的代理行為: 隨著AI代理(Agentic AI)變得更加普遍和複雜,AI-SPM 在運行時的精確控制和權限管理能力將持續演進,以應對日益自主的AI系統。

總而言之,AI安全態勢管理(AI-SPM)已不僅僅是一種新技術,它正在迅速成為安全採用人工智慧的標準安全層。對於希望充分釋放生成式AI潛能而不暴露於不可控風險的企業而言,AI-SPM是從隱形風險邁向顯而易見資產的關鍵載體。

資料來源:https://www.securityweek.com/will-ai-spm-become-the-standard-security-layer-for-safe-ai-adoption/

融入Palo Alto Networks、Tenable等產業觀點,闡述AI-SPM如何透過持續發現、評估與修復機制,有效應對大型語言模型(LLM)帶來的即時注入、資料外洩、模型中毒及影子AI等獨特風險,確保組織在多雲環境中安全、合規且可擴展地採用人工智慧。